Eine Lesart des WEF/Capgemini-Readiness-Berichts vom April 2026 zur Verwaltungs-Reife für agentische KI.

Drei deutsche Vorworte

Wenn ein internationaler Bericht zur Verwaltungs-Reife für agentische KI im April 2026 erscheint und gleich drei deutsche Vorworte trägt — Martina Klement (Berlin, Permanent Secretary für Digital Transformation), Fabian Mehring (Bayern, Staatsminister für Digitales) und Ammar Alkassar (Präsidium GovTech Deutschland) —, dann ist das kein zufälliges Vorwort-Bündel. Es ist ein Signal, dass der Bund-Länder-Dialog zu agentischer KI in der Verwaltung an einem gemeinsamen methodischen Punkt angekommen ist.

Der Bericht Making Agentic AI Work for Government — A Readiness Framework (World Economic Forum / Capgemini / Global Government Technology Centre Berlin, April 2026, 40 Seiten) baut auf 70 wiederkehrenden Government-Funktionen in neun Kategorien auf (S. 13) und mappt sie auf zwei Achsen: agentisches Potenzial und Implementierungs-Komplexität (S. 14). Drei Readiness-Zonen ergeben sich daraus — deploy, prepare, monitor (S. 15). Eine Topographie, wie der Bericht es selbst nennt: „The topography is a map, not a plan.“ (S. 25)

Methodische Vorbereitung als Disziplin

Dirk Günnewig hat den Bericht mit einer eigenen Lesart aufgenommen: agentische KI sei nicht autonomes Handeln, sondern Systeme, die eigenständig planen, entscheiden und handeln, um ein gegebenes Ziel zu erreichen. Seine Antwort darauf — „weder Euphorie noch Abwarten, sondern methodische Vorbereitung“ — trifft den Kern, den der Bericht selbst durchträgt: Sandbox-Erprobung, klare Nutzenerwartungen, robuste Governance, institutionelle Lernkurven.

Vier Punkte gehen über dieses Vokabular hinaus und kommen in der deutschen Diskussion noch zu wenig vor.

1. Funktionen statt Departments

Die übliche deutsche Sicht auf KI in der Verwaltung folgt Behördenstrukturen: ein Land prüft KI im Finanzressort. Eine Bundesoberbehörde startet einen Use-Case-Pilot. Eine Kommune testet einen Chatbot. Diese Sicht hat in der Vergangenheit funktioniert — für deterministische Software, die einer Linie zugeordnet ist.

Agentische KI passt nicht in diese Sicht. Eine Eligibility-Assessment-Funktion — der WEF-Bericht nimmt sie als Beispiel (S. 12) und meint damit, was im Deutschen am ehesten Anspruchsprüfung heißt — wirkt ressort-übergreifend: „spans diverse departments, such as social services, healthcare, education and housing“ (S. 12). Wenn agentische Templates für solche Funktionen entwickelt und institutionell gepflegt werden, wird ihre Wiederverwendung über Behördengrenzen hinweg zur eigentlichen Skalen-Quelle. Departments lassen sich neu schneiden; Funktionen bleiben.

Das ist nicht nur eine Engineering-Empfehlung. Es ist eine politische, weil sie verlangt, agentische Templates bei wem zu pflegen — und in welcher Konfiguration. Der Bericht überlässt diese Frage dem nationalen Kontext (Kapitel 2.4, S. 22); in Deutschland ist sie offen.

2. Reife-Treppe statt Schalter — der BMDS-Bauantrags-Use-Case

Im Anwendungsteil des Berichts (Use Case 2, S. 28) findet sich ein deutscher Use Case, der diesen Punkt konkret macht: das Bundesministerium für Digital Transformation und Government Modernization (BMDS) baut ein KI-System für Bauantragsverfahren bei Großprojekten — Verfahren, die laut Bericht „sometimes take longer than the projects they are meant to authorize, delaying investments despite available mandates and funding“ (S. 28).

Der Bericht beschreibt fünf logische Verarbeitungs-Funktionen des Systems: Anträge sichten am Tag des Eingangs („screened on the same day they arrive“), eingereichte Unterlagen strukturieren, fall-spezifische Sachverhalte auf einschlägige Rechtsnormen mappen, Regelungen über mehrere Rechtsdomänen hinweg konsolidieren, und auf dieser Basis Bescheid-Entwürfe generieren (S. 28). Bemerkenswert ist die bewusste Begrenzung des Norm-Korpus: nicht das gesamte Verwaltungsrecht wird gescannt, sondern „the system narrows the legal search to the relevant domains for each case – for example, a wind turbine permit only draws on specific environmental and regional regulations“ (S. 28). Aber, und das ist der eigentliche Punkt: unter human oversight, mit „limited autonomy at this stage, allowing for gradual expansion once confidence and reliability increase“ (S. 28).

Autonomie als Reife-Treppe statt Schalter. Das ist nicht das, was die internationale Diskussion oft suggeriert, wenn sie von autonomen Systemen spricht. Es ist, was in der Praxis trägt.

3. Choreographie statt Einzel-Agent

An dieser Stelle eine ausdrücklich eigene Lesart, die im Bericht nicht ausformuliert ist: der WEF-Eintrag (S. 28) beschreibt das BMDS-System als ein System mit fünf logischen Funktionen. Ob es technisch monolithisch oder als Multi-Agent-Architektur implementiert ist, sagt der Use-Case-Eintrag nicht — und ich weiß es nicht. Was hier folgt, ist deshalb keine Aussage über die konkrete BMDS-Implementation, sondern eine generische Engineering-Lesart der fünf Funktionen.

Liest man die fünf Schritte funktional — Sichten und Klassifizieren des Eingangs, Strukturieren der eingereichten Unterlagen, Mappen fall-spezifischer Sachverhalte auf den einschlägigen Norm-Korpus, Konsolidieren der relevanten Regelungen über mehrere Rechtsdomänen hinweg, Generieren eines Bescheid-Entwurfs, Übergabe an menschliche Sachbearbeitung —, liegen sie näher an einer Choreographie mehrerer spezialisierter Agenten als an einer monolithischen Pipeline. Jeder Schritt ist eine eigene Aufgabe mit eigenem Werkzeug-Set, eigenem Validierungs-Profil, eigenem Risikograd. Sie als getrennte Fachagenten zu denken — nicht als Schritte eines einheitlichen Systems — hätte zwei Vorteile.

Erstens: Wiederverwendbarkeit. Ein Norm-Mapping-Agent für Umweltrecht ist nicht nur in Bauanträgen relevant. Er ist relevant überall, wo Sachverhalte gegen Umweltnormen geprüft werden — Genehmigungen, Förderprüfungen, Compliance-Verfahren. Das ist die function-based-Logik aus Punkt 1, nur eine Ebene tiefer.

Zweitens: Kontrollierbarkeit. Wenn jeder Fachagent ein dokumentiertes Ergebnis zurückliefert — „das habe ich gefunden, das war die Quelle, das war meine Begründung“ —, ist die Eskalation an die menschliche Sachbearbeitung nicht ein Black-Box-Bescheid, der genehmigt werden muss. Sondern eine Aktenlage, in der die Sachbearbeiterin sieht, wie der Bescheid-Entwurf zustande gekommen ist. Vertrauen entsteht hier nicht trotz der KI, sondern durch die Choreographie ihrer Fachagenten.

Diese Lesart steht und fällt nicht mit der konkreten BMDS-Implementation. Sie beschreibt, wie man eine solche Verarbeitungskette bauen würde, wenn man Wiederverwendbarkeit und Kontrollierbarkeit maximieren will — und sie verändert die Diskussion, weil sie Mensch-im-Kreis nicht zu einer zusätzlichen Pflicht macht, sondern zu der Stelle, an der mehrere Agenten ihre Arbeit zusammen übergeben.

4. Sandbox als Vor-Live-Disziplin

Im Methoden-Kapitel des Berichts (Abschnitt 2.4 Develop clear strategies to mitigate risks and challenges, S. 24) erscheint sandbox testing als eine von mehreren Standard-Mitigationen gegen value-alignment-Risiken: „Mitigation includes ethical impact assessments, sandbox testing, continuous monitoring for bias and behavioural drift, human-in-the-loop validation, and definition of clear autonomy boundaries and rollback mechanisms for unintended actions.“ Lese ich diese Empfehlung im deutschen Kontext, dann ist Sandbox nicht Risikokontrolle – sondern Vor-Live-Disziplin. Eine Probebühne, auf der ein Stück geprobt wird, bevor es aufgeführt wird. Zwischen Konzept und Bescheid.

Das ist die wichtigere Lesart. Sandbox als Risikokontrolle behandelt agentische Systeme wie potenziell gefährliche Apparate, die abgesichert werden müssen. Sandbox als Vor-Live-Disziplin behandelt sie als kollaborative Werkbänke, an denen Mensch und Agenten-Choreographie einen Akt einüben, bevor er produktiv wird. Vertrauen entsteht nicht durch Logfiles, sondern durch geprobte Routine. Eine Sachbearbeiterin, die einen Bearbeitungs-Agenten mit seinen Fachagenten in der Sandbox arbeiten gesehen hat, gibt seine Vorschläge in der Produktion anders frei als jemand, der nur die Architektur-Diagramme gelesen hat.

Werkstatt der Republik

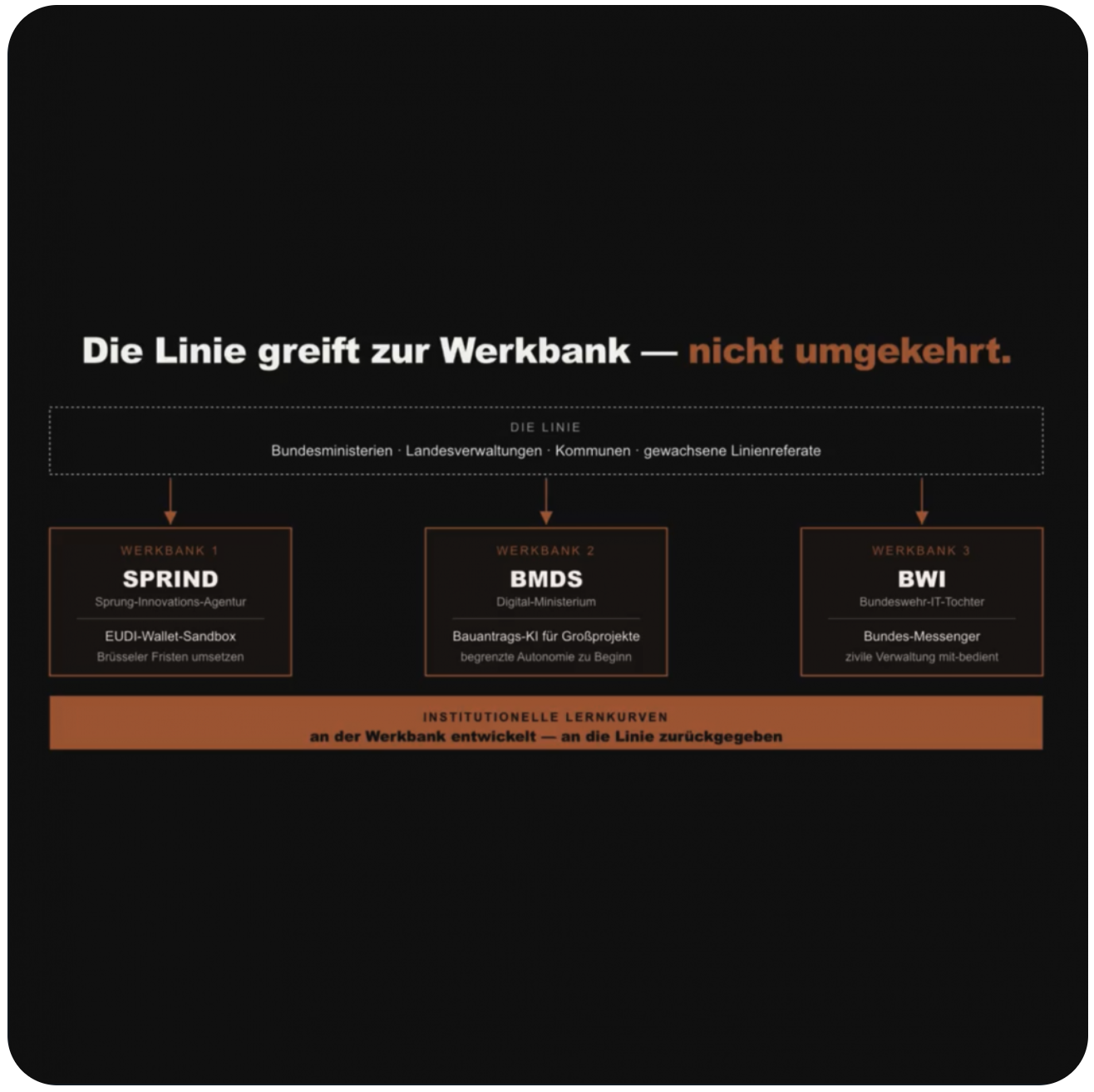

Wer SPRIND, BWI, BMDS und ihre aktuellen Großprojekte nebeneinander legt, sieht ein Muster. Eine Sprunginnovations-Agentur baut die EUDI-Wallet-Sandbox, an der Privatwirtschaft und Verwaltung gemeinsam testen können. Die Bundeswehr-IT-Tochter steuert den Bundesmessenger für die zivile Verwaltung bei. Das junge Digital-Ministerium gibt Pflicht-Aufgaben mit Brüsseler Fristen an die Sprunginnovations-Agentur weiter. Das ist nicht Skandal, sondern Diagnose: Die deutsche Linien-Verwaltung kann ihre eigenen Pflichten oft nicht aus eigener Kraft stemmen – und greift zu Sonderkörpern als Werkbänken.

Genau hier finden institutionelle Lernkurven statt. Sie entstehen nicht in den Linienreferaten, in denen weiterhin nach gewachsenen Mustern gearbeitet wird. Sie entstehen in den Sonderkörpern, an denen agentische Templates entwickelt, validiert und an die Linie zurückgegeben werden. Die Werkbank ist außerhalb der Linie – die Linie greift zur Werkbank, nicht umgekehrt.

Der WEF-Bericht macht diese Linie methodisch: function-based templates mit Wiederverwendung über Behördengrenzen hinweg. Drei deutsche Vorworte machen sie politisch: Bund-Länder-Konsens auf der Bühne, GovTech Deutschland als Brücke. Der BMDS-Bauantrags- Use-Case zeigt sie operativ: same-day-Sichtung, sauber begrenzter Norm-Korpus, eine Choreographie spezialisierter Fachagenten, human oversight als Architektur.

Was zu tun ist

„Methodische Vorbereitung“ bedeutet in dieser Lesart vier konkrete Dinge:

Function-based denken. Welche Funktionen wirken in einem Land und in welchen Ressorts? Welche Anspruchsprüfungs-Funktionen sind bereits identifiziert, und welche agentischen Templates lassen sich für sie entwerfen, die in mehreren Ressorts wiederverwendbar sind?

Choreographie statt Einzel-Agent bauen. Welche Fachagenten wären in einem konkreten Verfahren tatsächlich zu unterscheiden und welche Wiederverwendung über Verfahren hinweg ergibt sich daraus? Die Multi-Agent-Architektur ist nicht eine technische Spielerei, sondern der Mechanismus, mit dem Vertrauen über die Aktenlage entsteht.

Sandbox als Vor-Live-Disziplin auslegen. Welche Sandbox- Konfiguration erlaubt es Sachbearbeiter:innen, mit Bearbeitungs- und Fachagenten zu proben, bevor sie sie produktiv setzen; mit echten Workflows, echten Daten, echten Rollen, nicht in einem sterilen Test-Lauf?

Institutionelle Lernkurven sichtbar machen. Welche Sonderkörper trägt das Land — und welche braucht es noch? Wo fließen Lernkurven aus den Werkstätten zurück in die Linie?

Drei deutsche Vorworte und ein BMDS-Use-Case sind das Signal, dass das Sandbox-Vokabular in Deutschland nicht mehr Theorie ist. Die nächste Phase ist nicht ob, sie ist wo und wie schnell.